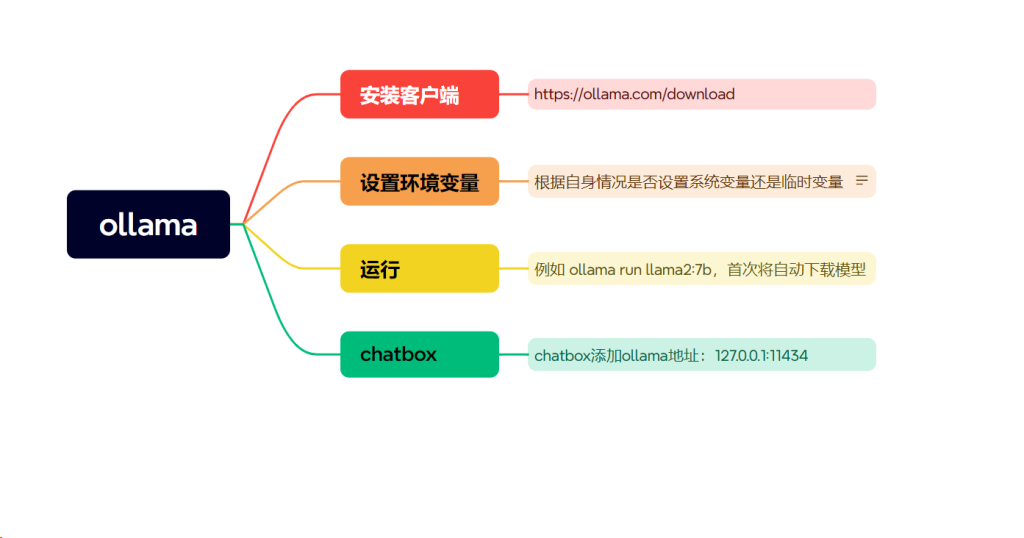

- 官网下载ollama软件并安装

- 根据需要设置环境变量,尤其是代理,不然网速非常慢

环境变量

OLLAMA_MODELS F:\xxx

存放模型目录,如果没有指定,就会默认放C盘,C盘空间大那就随意

OLLAMA_ORIGINS *

来源限制,设置为*表示可以任意源访问,没限制

OLLAMA_HOST 0.0.0.0

访问主机限制,如果想要网络上任意主机访问的话,就设置0.0.0.0

set HTTP_PROXY=http://127.0.0.1:xxxx

- 运行 ollama run llama2:2b,首次将自动下载模型

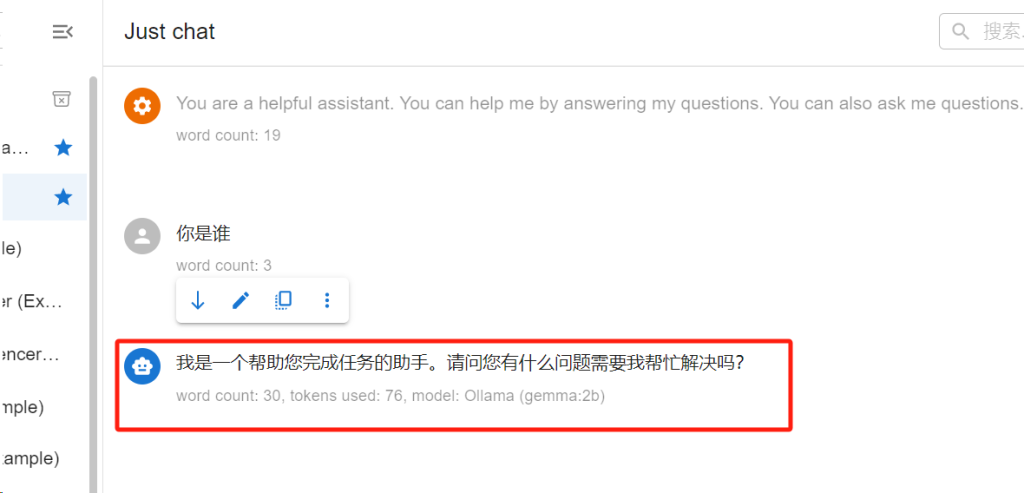

- 下载安装chatbox并添加ollama服务地址 127.0.0.1:11434

大工告成!体验GPT吧!